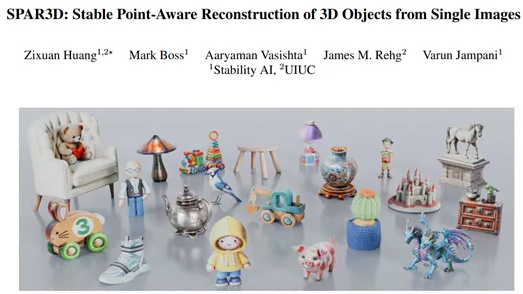

在计算机视觉领域,单图像3D 重建技术以其从二维图像中恢复三维物体形状和结构的能力,成为了一个备受关注的研究方向。近日,著名开源大模型平台 Stability-AI 推出了一款名为 SPAR3D 的创新模型,使得这一技术的实现速度达到了前所未有的0.7秒,为行业带来了巨大的变革。

单图像3D 重建面临着众多挑战,主要技术路线分为基于回归的方法和生成式建模的方法。基于回归的方法在推断可见表面时效率较高,但在处理遮挡区域时常常出现表面和纹理估计不准确的问题。而生成式方法则能够更好地处理不确定性区域,但其计算成本高且生成结果与可见表面对齐较差。

SPAR3D 通过结合这两种技术的优点,有效规避了各自的局限性,显著提升了重建的速度和准确性。

SPAR3D 的架构:高效的点采样与网格化

SPAR3D 的架构由两个主要阶段组成:点采样阶段和网格化阶段。

点采样阶段 :该阶段的核心是点扩散模型,能够根据输入的二维图像生成稀疏的点云,包含 XYZ 坐标和 RGB 颜色信息。采用 DDPM(Denoising Diffusion Probabilistic Models)框架,该模型通过添加高斯噪声和去噪器的反向过程,学习如何从含噪点云中恢复出噪声。在推理过程中,使用 DDIM(Denoising Diffusion Implicit Models)采样器生成点云样本,并通过分类器自由引导(CFG)提升采样的保真度。

网格化阶段 :该阶段的目标是从输入的图像和点云中生成带有纹理的三维网格。SPAR3D 采用了大型三平面 Transformer,能够从图像和点云中预测出三平面特征,进而估计物体的几何形状、纹理和照明。训练过程中,通过可微渲染器使用渲染损失来监督模型,确保生成结果的真实感和质量。

显著性能:超越传统方法

在 GSO 和 OmniObject3D 数据集的测试中,SPAR3D 在多个评估指标上均显著优于传统的回归和生成式基线方法。例如,在 GSO 数据集中,SPAR3D 的 CD(Chamfer Distance)值为0.120,FS@0.1为0.584,PSNR(Peak Signal-to-Noise Ratio)为18.6,而其他方法的表现则相对较弱。在 OmniObject3D 数据集中,SPAR3D 同样展现出优异的性能,CD 值为0.122,FS@0.1为0.587,PSNR 为17.9。

这些结果充分证明了 SPAR3D 在几何形状和纹理质量方面的卓越表现,展现了其在实际应用中的潜力。

结语:开源技术的未来

随着技术的不断进步和应用场景的扩展,SPAR3D 无疑将在计算机视觉和3D 重建领域扮演重要角色。对于开发者和研究者而言,SPAR3D 的开源特性意味着更多的创新与应用机会。

开源地址:https://github.com/Stability-AI/stable-point-aware-3d

Huggingface:https://huggingface.co/stabilityai/stable-point-aware-3d