近日,MiniMax公司宣布推出其全新模型MiniMax-M1,该模型作为世界上首个开源的大规模混合架构推理模型,在面向生产力的复杂场景中展现出了卓越性能,成为开源模型中的佼佼者。MiniMax-M1不仅超越了国内闭源模型,还接近了海外最领先模型的水平,同时保持着业内最高的性价比。

MiniMax-M1的一个显著特点是支持高达100万的上下文输入,与闭源模型Google Gemini2.5Pro相当,是DeepSeek R1的8倍,并且能够输出长达8万Token的推理结果。这一成就得益于MiniMax独创的以闪电注意力机制为主的混合架构,使得在处理长上下文输入和深度推理时效率显著提升。例如,在使用8万Token进行深度推理时,MiniMax-M1仅需DeepSeek R1约30%的算力,从而在训练和推理过程中都具有算力效率优势。

此外,MiniMax还提出了更快的强化学习算法CISPO,通过裁剪重要性采样权重来提升强化学习效率。在AIME的实验中,CISPO算法的收敛性能比包括字节近期提出的DAPO在内的其他强化学习算法快了一倍,显著优于DeepSeek早期使用的GRPO算法。这些技术创新使得MiniMax-M1的强化训练过程异常高效,仅用了512块H800三周的时间,租赁成本也大幅降低,比预期少了一个数量级。

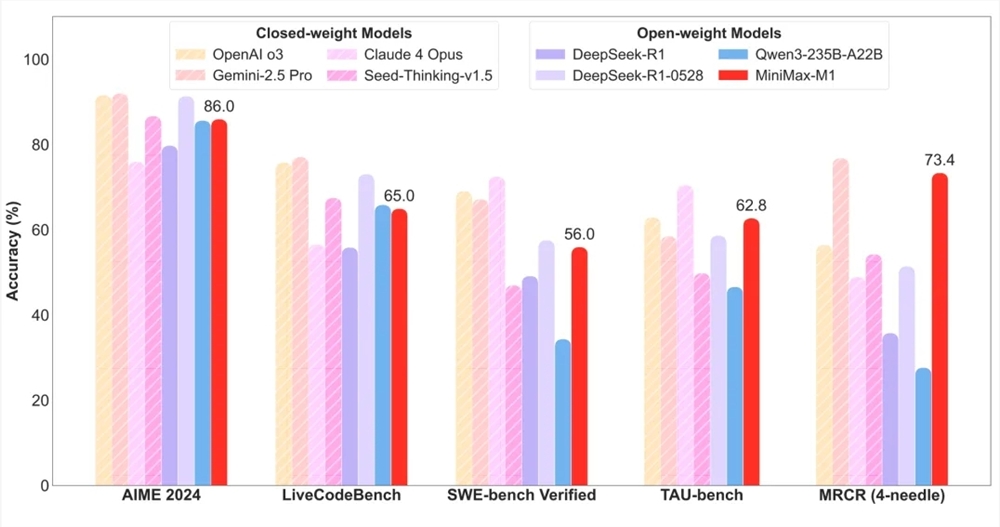

在评测方面,MiniMax-M1在业内主流的17个评测集上均取得了优异成绩。特别是在软件工程、长上下文与工具使用等面向生产力的复杂场景中,MiniMax-M1展现出了显著优势。例如,在SWE-bench验证基准上,MiniMax-M1-40k和MiniMax-M1-80k分别取得了55.6%和56.0%的成绩,虽然略逊于DeepSeek-R1-0528的57.6%,但显著超越了其他开源权重模型。同时,依托其百万级上下文窗口,MiniMax-M1在长上下文理解任务中表现卓越,超越了所有开源权重模型,甚至在某些方面超越了OpenAI o3和Claude4Opus,全球排名第二。

值得一提的是,MiniMax-M1在代理工具使用场景(TAU-bench)中也同样领跑所有开源权重模型,并战胜了Gemini-2.5Pro。此外,MiniMax-M1-80k在大多数基准测试中始终优于MiniMax-M1-40k,这充分验证了扩展测试时计算资源的有效性。

在价格方面,MiniMax-M1保持了业内最低的价格。在MiniMax APP和Web上,用户可以不限量免费使用该模型,并通过官网以极具竞争力的价格购买API服务。这一举措无疑将进一步推动MiniMax-M1在市场上的普及和应用。

MiniMax-M1-40k:huggingface.co/MiniMaxAI/MiniMax-M1-40k

MiniMax-M1-80k:huggingface.co/MiniMaxAI/MiniMax-M1-80k